Komendy głosowe są już od jakiegoś czasu pod lupą specjalistów od bezpieczeństwa. Oprócz oczywistego problemu, jakim jest zbieranie danych z mikrofonów bez wiedzy użytkownika, kłopotem jest to, że polecenie głosowe może wydać dowolna osoba. Ten element jest podatny na manipulacje - wymuszano już np. jego aktywację z pomocą ultradźwięków. Niepokojące jest to, że taka opcja jest możliwa, mimo że urządzenia posiadają specjalne filtry na takie częstotliwości. Okazuje się jednak, że wcale nie trzeba dźwięku, by aktywować komendę głosową.

SIRI, Alexa i Asystent Google mogą zostać włączone przy pomocy lasera

Wybudzanie asystentów głosowych takich jak Siri czy Asystent Google i sterowanie nimi z użyciem lasera zostało odkryte przez naukowców z University of Michigan oraz University of Electro-Communications w Tokio, podaje portal niebezpiecznik.pl. Taka możliwość istnieje, ponieważ nowoczesne mikrofony MEMS reagują nie tylko na drgania powietrze, ale także na wiązkę światła. Takeshi Sugawara zauważył, że skierowanie lasera na mikrofon, sprawia, że ten wydaje dźwięk o określonej częstotliwości. Co istotne, efekt wywołany wiązką światła nie był zależny od długości fali, a jedynie od jej intensywności.

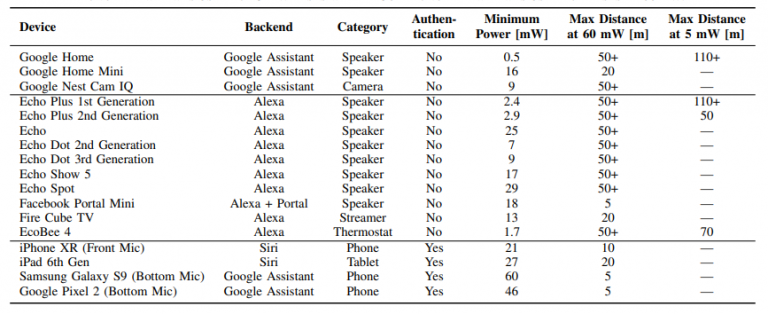

Naukowcy wpadli na pomysł, że w ten sposób możliwe jest manipulowanie urządzeniami nawet z dużej odległości. Żeby to zrobić, trzeba mieć odpowiedni sprzęt, ale ten może nie jest wyjątkowo drogi, ale do najtańszych też nie należy - wystarczy laser za kilkanaście dolarów, sterownik diody laserowej (ok. 340 dolarów), wzmacniacz (ok. 30 dolarów) oraz teleobiektyw (ok. 200 dolarów). Konieczne jest też poznanie specyfikacji urządzenia, które jest celem ataku. Ale to mały problem, bo wszystkie dane można znaleźć w internecie. W zależności od sprzętu, który ma być przejmowany, trzeba inaczej skalibrować laser.

Naukowcom udało się zaatakować urządzenie znajdujące się w budynku obok, 75 m dalej. Na przeszkodzie nie stanęły okna obu budynków. Największa odległość jaką udało się uzyskać to 110 m, bo takim korytarzem dysponowali badacze.

Wyjątkowo groźne ataki

Takie ataki mogą stać się wyjątkowo groźne, ponieważ z pomocą głosu, można np. otworzyć drzwi do garażu, co umożliwi włamanie, można też kontrolować inne urządzenia w domu, robić zakupy online, uruchamiać zdalnie pojazdy, otwierać zamki do drzwi. Niebezpieczeństwo jest więc realne i poważne.

Jak uniknąć takiego ataku? Warto ukryć urządzenia do sterowana głosem w domu, tak by nie było widać ich z zewnątrz. Smartfon może być trudniejszy do zhackowania tą drogą, ze względu na swoją mobilność, ale wciąż jest to możliwe. Nie powinniśmy zatem kłaść go na widoku. Trzeba liczyć też, że producenci rozwiną na tyle rozpoznawanie głosu, że urządzenie będzie mógł aktywować tylko przypisany doń użytkownik.